05 okt Hersensignalen omgezet naar spraak met implantaten en AI

Persbericht Radboud Universiteit

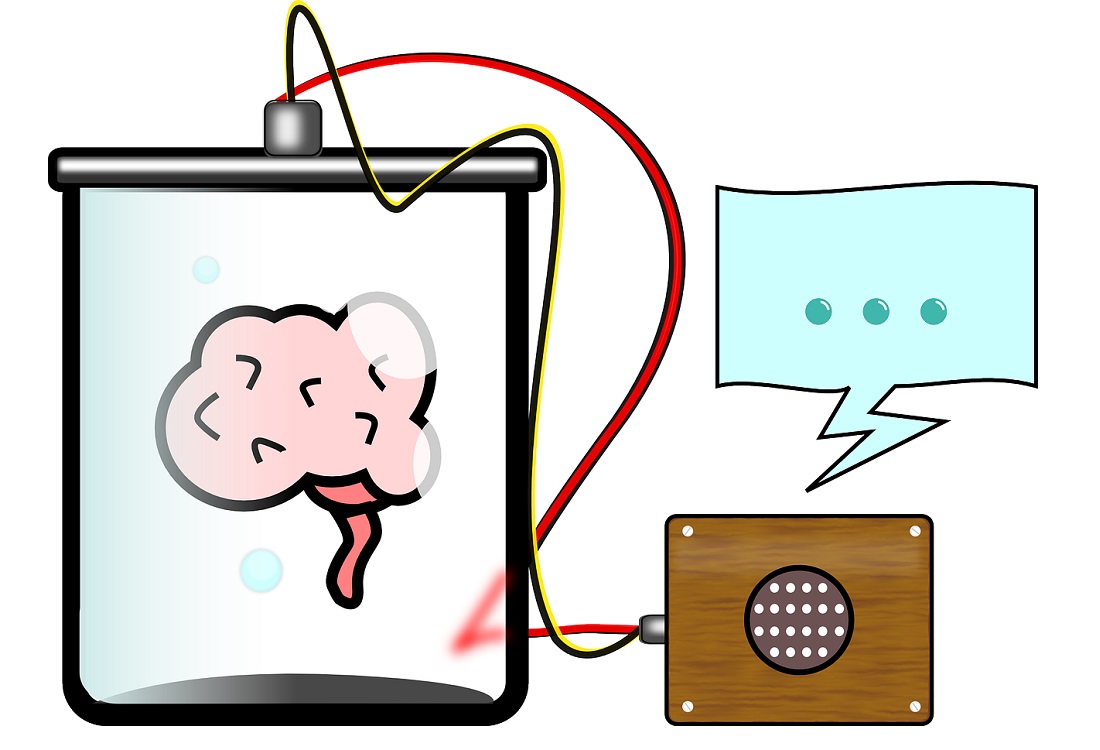

Onderzoekers van de Radboud Universiteit en het UMC Utrecht zijn erin geslaagd hersensignalen om te zetten in hoorbare spraak. Door signalen uit de hersenen te decoderen met een combinatie van implantaten en AI, konden ze met een nauwkeurigheid van 92 tot 100 procent voorspellen welke woorden mensen wilden zeggen. De resultaten van hun onderzoek zijn onlangs gepubliceerd in het Journal of Neural Engineering.

Het onderzoek wijst op een veelbelovende ontwikkeling op het gebied van brein-computerinterfaces, aldus hoofdauteur Julia Berezutskaya, onderzoeker aan het Donders Instituut voor Brein, Cognitie en Gedrag van de Radboud Universiteit en het UMC Utrecht. Berezutskaya en collega’s van het UMC Utrecht en de Radboud Universiteit hebben hersenimplantaten bij patiënten met epilepsie gebruikt om na te gaan wat mensen zeiden.

Mensen weer een stem geven

“Uiteindelijk hopen we deze technologie beschikbaar te maken voor patiënten met het locked-in-syndroom, die verlamd zijn en niet kunnen communiceren”, vertelt Berezutskaya. “Deze mensen verliezen het vermogen om hun spieren te bewegen, en dus om te spreken. Door een brein-computerinterface te ontwikkelen, kunnen we hersenactiviteit analyseren en ze weer een stem geven.”

In het nu gepubliceerde nieuwe onderzoek vroegen de onderzoekers niet-verlamde mensen met tijdelijke hersenimplantaten om een aantal woorden hardop uit te spreken terwijl hun hersenactiviteit werd gemeten. Berezutskaya vertelt: “We konden toen een directe vergelijking maken tussen hersenactiviteit en spraak. We hebben ook geavanceerde AI-modellen gebruikt om die hersenactiviteit rechtstreeks om te zetten in hoorbare spraak. Het lukte dus niet alleen om te raden wat mensen zeiden, maar we konden die woorden ook meteen omzetten in begrijpelijke, verstaanbare geluiden. Bovendien klonk de gereconstrueerde spraak zelfs als de oorspronkelijke spreker wat betreft toon en manier van spreken.”

Over de hele wereld werken onderzoekers aan manieren om woorden en zinnen in hersenpatronen te herkennen. Het lukte de onderzoekers om begrijpelijke spraak te reconstrueren met relatief kleine datasets, waaruit blijkt dat hun modellen de complexe ‘mapping’ tussen hersenactiviteit en spraak kunnen onthullen met beperkte gegevens. Essentieel daarbij was dat ze ook luistertests uitvoerden met vrijwilligers om te evalueren hoe goed de gesynthetiseerde woorden te verstaan waren. De positieve resultaten van die tests wijzen erop dat de technologie niet alleen woorden juist weet te identificeren, maar dat ze die woorden hoorbaar en begrijpelijk kan overbrengen, net als bij een echte stem.

Beperkingen

“Er zijn nog wel een aantal beperkingen”, waarschuwt Berezutskaya. “Bij deze experimenten vroegen we de deelnemers om twaalf woorden hardop te zeggen, en dat waren de woorden die we probeerden te detecteren. Over het algemeen is het voorspellen van individuele woorden minder ingewikkeld dan het voorspellen van hele zinnen. In de toekomst kunnen grote taalmodellen die worden gebruikt bij AI-onderzoek nuttig zijn. Ons doel is om volledige zinnen en alinea’s te voorspellen van wat mensen proberen te zeggen, uitsluitend op basis van hun hersenactiviteit. Om dat te bereiken, zijn er meer experimenten, geavanceerdere implantaten, grotere datasets en geavanceerde AI-modellen nodig. Dit zal nog wel een aantal jaar duren, maar het ziet ernaar uit dat we op de goede weg zijn.”

Lees hier het onderzoeksartikel dat gepubliceerd is in Journal of Neural Engineering.

Geen reactie's